Das KI-Experiment von Ubisoft weist ein Problem der geschlechtsspezifischen Voreingenommenheit auf

Auf der Game Developers Conference dieser Woche bot Ubisoft einen möglichen Einblick in eine Zukunft voller KI für Gamer. Das Unternehmen stellte auf der Messe einen Prototyp vor, der den Ace-Mikroservice von Nvidia nutzte, um voll vertonte „intelligente NPCs“ zu produzieren, mit denen Spieler interagieren konnten, indem sie in ein Mikrofon sprechen. Obwohl wir online auf Skepsis stoßen (auch bei mir selbst), hat uns die Demo selbst beeindruckt, als wir sie ausprobiert haben. Ich hatte ein überraschend überzeugendes Gespräch mit einem umweltbewussten NPC über die Ethik des Ökoterrorismus, ein völlig unkonventionelles Gespräch, das durch KI ermöglicht wurde.

Es ist einer der stärkeren Anwendungsfälle, die wir bisher von der Technologie gesehen haben, aber es weist einen überraschenden Mangel auf, den selbst Ubisoft nur schwer lösen kann: sprachliche Voreingenommenheit.

Die geheime Voreingenommenheit der KI

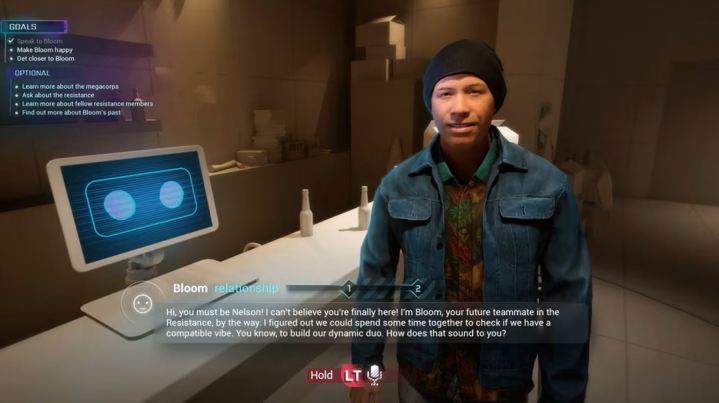

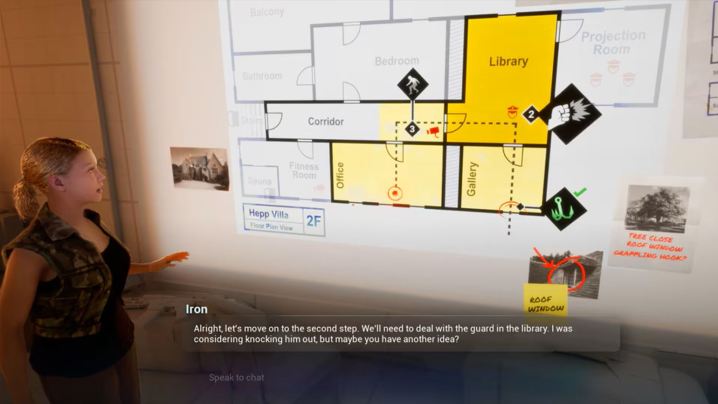

In der kurzen Demo schlüpfte ich in die Rolle einer Raumfahrerfigur, die sich in den Kampf einer Widerstandsgruppe gegen einen Megakonzern einmischt. In der dreiteiligen Demo unterhielt ich mich mit zwei verschiedenen Charakteren, für die Ubisoft lange Hintergrundgeschichten erstellt und diese in Nvidias Ace-Tool eingespeist hat. Ich lernte die Science-Fiction-Welt kennen, indem ich mit einem NPC plauderte, ihn nach seinen Kameraden fragte, bevor ich mit kreativem Denken einen perfekten Raubüberfall plante.

Nachdem ich meine Demo fertiggestellt hatte, fragte ich zwei Ubisoft-Mitarbeiter, die an dem Projekt beteiligt waren, ob es irgendwelche Mängel an dem Tool gäbe, die sie frustrierten. Obwohl ihnen die Technik insgesamt sehr am Herzen lag, wurde aus einigen tiefen Seufzern deutlich, dass sie noch eine lange Liste von Problemen hatten, die behoben werden mussten, bevor das Studio die Technik vollständig einführte. Ihr größter Kritikpunkt ist die inhärente Voreingenommenheit der englischen Sprache, ein menschliches Problem, das die KI derzeit standardmäßig übernimmt.

Die Demoisten wiesen auf zwei konkrete Beispiele hin, die mir während des Durchspielens noch nicht einmal aufgefallen waren. Irgendwann habe ich einen NPC gebeten, mir von seinem am wenigsten bevorzugten Mitglied seines Teams zu erzählen. Nachdem sie mir erzählt hatten, dass sie alle ihre Crewmitglieder liebten, warfen sie einen Charakter namens Iron vor den Kopf, weil er ein stacheliger Kerl sei. Es gab nur ein Problem: Eisen sollte kein Mann sein.

Den Demoisten zufolge scheint das KI-Tool das Wort „Eisen“ mit Männlichkeit zu assoziieren. Daher wird davon ausgegangen, dass Iron, der Charakter, männlich ist. Ein ähnliches Problem taucht auf, wenn der NPC über eine Figur namens Bloom spricht, die als süße, fürsorgliche Frau beschrieben wird. Das ist das Eisenproblem, das umgekehrt auftritt; „Bloom“ scheint von der Maschine als weiblicher Begriff interpretiert zu werden, der einer männlichen Figur ein mütterliches Stereotyp aufpfropft. Diese Beispiele sind klein, aber sie öffnen die Tür für einige größere Probleme, wenn sie nicht aktiviert werden. Wie wird beispielsweise der generative KI-Dialog mit Rasse umgehen?

Dies ist kein spezifisches Problem des Nvidia-Tools oder der KI im Allgemeinen; Es spiegelt eine faszinierende Nuance der Sprache wider. Große Sprachmodelle (LLMs) wie das hier verwendete spiegeln einfach die Art und Weise wider, wie Menschen sprechen, basierend auf der Menge an Daten, auf die sie trainiert werden. Das bedeutet, dass es sich zwangsläufig von Zeit zu Zeit einige unangenehme Gewohnheiten aneignen wird, wie zum Beispiel die Verbreitung von Geschlechterstereotypen. Während die NPCs von Ubisoft über lange, von Autoren handgefertigte Hintergrundgeschichten verfügen, lernen sie immer noch aus allgemeineren Sprachlerndatensätzen. KI-Unternehmen wie Convai, die dieses Jahr Nvidias Kairos-Demo auf der CES unterstützt haben, geben zu, dass sie den genauen Inhalt, auf den diese Datensätze trainiert werden, nicht wirklich kennen.

Dieses Problem wird nur noch komplizierter, wenn man bedenkt, was es für verschiedene Sprachen bedeutet. Die Entwickler, mit denen ich gesprochen habe, wiesen darauf hin, dass generative KI derzeit auf Englisch ausgerichtet ist. Andere Sprachen können jedoch völlig anders sein, was eine zusätzliche Herausforderung für diejenigen darstellt, die Tools wie Ace einführen möchten. Was für englischsprachige Menschen Standard ist, macht in einem anderen Land möglicherweise keinen Sinn. Wie lokalisiert man eine Maschine, die eigentlich nur eine Sprache beherrscht?

Ubisoft und Nvidia versuchen nicht, diese Mängel zu verbergen. Die Mitarbeiter, mit denen ich während der Demo gesprochen habe, betonten, wie wichtig die Zusammenarbeit mit internen DEI-Teams ist, die dabei helfen können, Schwachstellen zu identifizieren und die von der Schreib-KI ausgespuckten Zeichen zu korrigieren. So beeindruckt ich auch war, eine mitreißende philosophische Debatte mit einem KI-NPC zu führen, es ist klar, dass diese Maschinen immer noch viel menschliche Hilfe benötigen, um die Instinkte zu reparieren, die wir ihnen versehentlich eingeimpft haben.